Comprendre la notation Big O : Guide sur la complexité algorithmique

Sommaire

ToggleIntroduction à la complexité algorithmique

La complexité algorithmique est une notion fondamentale dans le développement de logiciels et l’informatique en général. Elle désigne la mesure des ressources nécessaires pour exécuter un algorithme, notamment en ce qui concerne le temps et l’espace utilisés. Comprendre cette complexité est essentiel pour concevoir des algorithmes efficaces et performants, permettant d’optimiser les applications et d’améliorer l’expérience utilisateur. Dans un monde où les données augmentent de manière exponentielle, la capacité à évaluer la complexité d’un algorithme devient primordiale.

L’un des outils principaux utilisés pour analyser cette complexité est la notation Big O. Cette notation offre une façon standardisée de classer les algorithmes en fonction de leur performance et de leur efficacité lorsque la taille d’entrée des données augmente. La notation Big O évalue le comportement asymptotique d’un algorithme, ce qui signifie qu’elle s’intéresse surtout à sa rapidité et à sa consommation de ressources dans des limites élevées. Cette approche permet non seulement de comparer différents algorithmes, mais aussi de prédire leur comportement en fonction de la croissance des données.

En analysant la complexité d’un algorithme à l’aide de la notation Big O, les développeurs peuvent identifier les goulots d’étranglement et optimiser leur code pour atteindre une meilleure performance. Cela englobe à la fois le temps d’exécution, souvent appelé complexité temporelle, et l’utilisation de la mémoire, qualifiée de complexité spatiale. Cette évaluation est cruciale dans des contextes variés, depuis le traitement de données massives jusqu’aux applications en temps réel, car elle influence directement la réactivité et la scalabilité des systèmes logiciels. Ainsi, la complexité algorithmique et la notation Big O forment une base essentielle pour tout ingénieur logiciel cherchant à développer des solutions efficaces et robustes.

Qu’est-ce que la notation Big O ?

La notation Big O est un outil fondamental en analyse algorithmique, utilisé pour exprimer et comparer la complexité des algorithmes. Spécifiquement, elle décrit la performance d’un algorithme en fonction de la taille de l’entrée, permettant aux développeurs d’évaluer son efficacité. La note Big O se concentre principalement sur le temps d’exécution et l’espace mémoire requis, offrant ainsi une perspective précieuse sur la façon dont un algorithme évolue avec l’augmentation des données.

Pour comprendre la notation Big O, il est essentiel de se familiariser avec ses principes de base. Lorsqu’un algorithme est exprimé en termes de Big O, la notation représente le comportement asymptotique du temps ou de l’espace utilisé. Par exemple, l’expression O(n) indique que le temps de traitement ou la mémoire utilisée augmente linéairement avec la taille de l’entrée, n. Cette approche permet aux ingénieurs et aux chercheurs d’estimer rapidement et onjectivement la complexité d’un algorithme, facilitant ainsi la prise de décision lors du choix de la meilleure méthode à utiliser.

Il est également important de noter que la notation Big O ne fournit pas de mesures précises, mais plutôt des estimations puissantes des performances. Elle ignore les constantes et les termes moins significatifs pour se concentrer sur le terme dominant qui a le plus grand impact sur le comportement d’un algorithme à grande échelle. Cette abstraction permet une comparaison plus facile entre différents algorithmes. Par exemple, un algorithme ayant une complexité de O(n^2) sera généralement moins performant qu’un algorithme avec une complexité O(n) lorsque la taille de l’entrée devient très grande.

Pourquoi est-il important de comprendre la complexité algorithmique ?

La compréhension de la complexité algorithmique est cruciale pour tout développeur de logiciels. Elle permet d’évaluer l’efficacité d’un algorithme et de prédire son comportement face à différentes tailles de données. En utilisant la notation Big O, les développeurs peuvent classifier et comparer les algorithmes en fonction de leur performance. Par conséquent, des choix d’algorithmes plus efficaces peuvent être faits, améliorant ainsi les performances globales des applications.

Un des principaux avantages de maîtriser la complexité algorithmique est la capacité à anticiper comment un algorithme se comportera sous pression. En général, le temps et l’espace nécessaires pour exécuter un algorithme sont des préoccupations majeures. Un algorithme qui fonctionne bien pour de petites quantités de données peut avoir des performances inadéquates lorsqu’il est confronté à des volumes plus importants. Grâce à la compréhension de la complexité, les développeurs peuvent éviter les algorithmes inefficaces qui entraîneraient des délais de traitement significatifs.

En outre, la sélection d’algorithmes appropriés, basés sur leur complexité, est essentielle pour l’optimisation des performances dans des projets de développement. Par exemple, choisir un algorithme avec une complexité logarithmique plutôt qu’une complexité quadratique peut réduire considérablement le temps d’exécution. Cela est particulièrement important dans les applications en temps réel où chaque milliseconde compte. Ainsi, la complexité algorithmique influence non seulement l’efficacité des solutions, mais aussi l’expérience utilisateur finale.

En somme, la compréhension de la complexité algorithmique est essentielle pour s’assurer que les applications sont développées de manière à optimiser les ressources, à minimiser les temps de réponse et à garantir un fonctionnement efficace dans des environnements variés.

Les différents types de complexité en notation Big O

La notation Big O est un concept fondamental en informatique, servant à évaluer la complexité des algorithmes. Il existe plusieurs types de complexité que l’on peut rencontrer, chacun ayant un impact différent sur la performance des algorithmes. Cette section examine quelques-uns des types les plus courants.

Tout d’abord, nous avons O(1), connu sous le nom de complexité constante. Un algorithme avec cette complexité exécute le même nombre d’opérations, quelle que soit la taille de l’entrée. Par exemple, accéder à un élément d’un tableau par son index est une opération O(1). Cela signifie que le temps nécessaire pour effectuer cette opération ne change pas, même si la taille du tableau augmente.

Ensuite, nous observons O(n), qui est une complexité linéaire. Dans ce cas, le temps d’exécution de l’algorithme augmente proportionnellement à la taille de l’entrée. Par exemple, un algorithme qui parcourt une liste de n éléments une seule fois présente une complexité de O(n).

Une autre forme de complexité est O(n^2), désignée par la complexité quadratique. Elle survient lorsqu’un algorithme nécessite de parcourir une liste de n éléments plusieurs fois. Un exemple classique est celui des algorithmes de tri à bulles, où chaque élément doit être comparé à tous les autres, créant ainsi une croissance exponentielle du temps d’exécution avec l’augmentation de n.

Enfin, O(log n) est une complexité logarithmique. Ce type d’algorithme fonctionne en divisant systématiquement l’entrée en sous-ensembles pour rechercher une solution. Un exemple typique est la recherche binaire, où l’intervalle de recherche est réduit de moitié à chaque étape, rendant cette méthode très efficace pour les grands ensembles de données triés.

Chacun de ces types de complexité a un rôle essentiel dans l’évaluation de la performance des algorithmes, permettant ainsi aux développeurs de choisir des solutions optimales en fonction de la nature de leurs données et de leurs exigences. Comprendre ces types est donc crucial dans le développement d’applications efficientes.

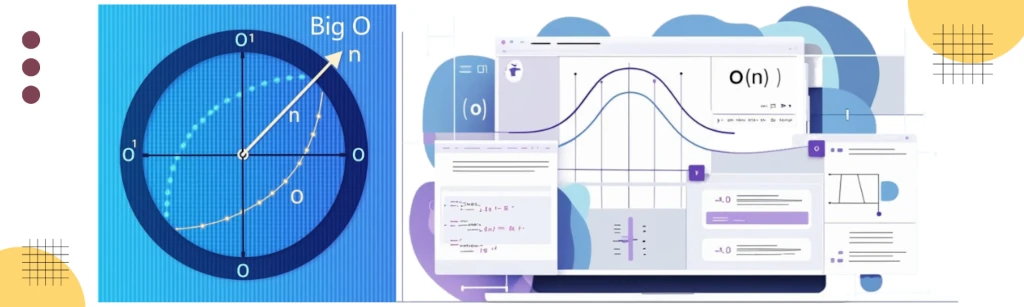

Interprétation des graphiques de complexité

Les graphiques de complexité algorithmique jouent un rôle essentiel dans l’évaluation de la performance d’un algorithme. Ils permettent de représenter visuellement comment le temps d’exécution ou l’espace mémoire requis d’un algorithme évolue en fonction de la taille de l’entrée. Ces visualisations sont particulièrement utiles pour comparer différents algorithmes et choisir celui qui convient le mieux à un problème donné.

Dans un graphique typique, l’axe des abscisses représente la taille de l’entrée, tandis que l’axe des ordonnées montre le temps de calcul ou l’espace mémoire. Les courbes tracées sur ce graphique illustrent la relation entre la taille de l’entrée, la complexité et la performance de l’algorithme. Par exemple, une courbe linéaire indique un algorithme dont le temps d’exécution augmente proportionnellement à la taille des données. En revanche, des courbes exponentielles suggèrent une complexité bien plus élevée, indiquant que l’algorithme devient rapidement impraticable pour de grandes entrées.

Il est crucial d’interpréter ces graphiques avec précaution. La complexité algorithmique n’est pas toujours représentée de manière uniforme pour tous les cas d’utilisation. Les meilleures et pires performances peuvent varier considérablement. Il est donc recommandé d’analyser plusieurs aspects du graphique, tels que les cas moyen, meilleur et pire. Cela permet d’obtenir une vue d’ensemble plus complète de la performance d’un algorithme.

En utilisant ces graphiques pour évaluer et comparer des algorithmes, les développeurs peuvent prendre des décisions éclairées lorsque cela concerne l’optimisation du code. C’est ce qui rend l’interprétation des graphiques de complexité incontournable pour une compréhension approfondie de la manière dont les algorithmes se comportent face à des inputs variés.

Exemples simples de notation Big O

Pour mieux comprendre la notation Big O et sa pertinence dans l’analyse algorithmique, examinons quelques exemples typiques d’algorithmes simples. Ces exemples illustre la complexité de différents scénarios et offrent une perspective sur la performance attendue lors de l’évaluation d’algorithmes.

Commençons par l’algorithme de recherche linéaire. Dans cet algorithme, un élément est recherché dans une liste en parcourant chaque élément un par un jusqu’à ce que l’élément cible soit trouvé ou que la fin de la liste soit atteinte. La complexité temporelle de cette approche est O(n), où n représente le nombre d’éléments dans la liste. Cela signifie qu’en cas d’augmentation de la taille de la liste, le temps nécessaire à la recherche augmente linéairement.

Un autre exemple serait le tri à bulles, un algorithme de tri simple. Cet algorithme compare chaque paire d’éléments adjacents dans une liste et les échange si nécessaire pour les trier. La complexité temporelle du tri à bulles est également O(n²). Cette notation signifie que dans le pire des cas, le temps nécessaire augmente de manière quadratique par rapport au nombre d’éléments, ce qui peut rendre cet algorithme inefficace pour de grandes listes.

Un dernier exemple pourrait être la recherche binaire, qui fonctionne sur des listes triées. Cet algorithme divise la liste en deux à chaque itération pour localiser l’élément cible plus rapidement. Sa complexité temporelle est O(log n), indiquant que le temps de traitement augmente logarithmiquement avec la taille des données. Ainsi, même pour de grandes listes, la performance reste relativement bonne grâce à cette approche).

Ces exemples illustrent non seulement la diversité des algorithmes, mais également comment la notation Big O aide à quantifier la complexité et la performance dans divers contextes d’algorithmique.

Optimisation des algorithmes via la notation Big O

La notation Big O est un outil essentiel dans l’évaluation de la complexité algorithmique, car elle permet d’analyser les performances des algorithmes en tenant compte du temps d’exécution et de l’espace mémoire requis en fonction de la taille de l’entrée. Pour optimiser les algorithmes, il est crucial de commencer par une évaluation précise de leur complexité afin de savoir où se situent les goulots d’étranglement.

Une stratégie clé consiste à réduire la complexité en choisissant des algorithmes adaptés aux tâches spécifiques à accomplir. Par exemple, pour trier des données, l’algorithme quicksort, avec une complexité moyenne de O(n log n), est souvent plus performant que le tri par bulle, qui présente une complexité de O(n²). Par conséquent, remplacer un algorithme inefficace par un autre plus efficient est une méthode classique d’optimisation.

Un autre aspect essentiel de l’optimisation réside dans l’utilisation de structures de données appropriées. Par exemple, les listes chaînées, les arbres binaires de recherche ou les tables de hachage peuvent jouer un rôle déterminant dans l’amélioration des performances. Ces structures permettent l’accès, l’insertion et la suppression d’éléments avec une complexité réduite, augmentant ainsi l’efficacité globale de l’algorithme.

D’autres techniques comprennent la réduction de la taille des données à traiter, souvent réalisée par filtrage ou échantillonnage, qui diminue non seulement la complexité mais aussi le temps d’exécution global. L’importance du prétraitement des données ne peut être sous-estimée, car un bon formatage et une bonne organisation des données peuvent contribuer considérablement à la performance des algorithmes.

En somme, optimiser un algorithme nécessite une compréhension approfondie de la notation Big O et un choix judicieux des techniques et structures de données. L’optimisation est un processus continu qui repose sur l’analyse des performances et l’adaptabilité des algorithmes face aux exigences changeantes des applications modernes.

Erreurs courantes à éviter dans la mesure de la complexité

Lorsque les développeurs mesurent la complexité algorithmique, ou la complexité, plusieurs erreurs fréquentes peuvent survenir, compromettant ainsi l’évaluation précise de la performance d’un algorithme. L’une des erreurs les plus courantes est de ne pas tenir compte du cas moyen. Souvent, les développeurs se concentrent uniquement sur le pire des cas, négligeant l’analyse du comportement des algorithmes dans des scénarios plus typiques. Cela peut mener à des conclusions erronées sur l’efficacité d’un algorithme et son adéquation à un problème particulier.

Une autre erreur consiste à ignorer les détails d’implémentation lors de l’évaluation de la complexité. Même si deux algorithmes peuvent avoir la même complexité théorique, leur performance réelle peut varier considérablement en fonction des optimisations et des choix de structure de données. Par conséquent, il est crucial d’examiner non seulement le big O de chaque algorithme, mais également comment ils sont exécutés dans un environnement de programmation donné.

Les développeurs doivent également être prudents lorsqu’ils utilisent la notation Big O pour comparer des algorithmes. Une comparaison superficielle peut prêter à confusion, car le temps d’exécution peut être influencé par d’autres facteurs tels que la taille des données d’entrée et les limitations du matériel. Le choix d’une mesure appropriée est essentiel pour donner une indication précise de la performance d’un algorithme.

Enfin, la négligence des effets de l’environnement d’exécution, tels que la mémoire et l’utilisation des ressources, peut également biaiser les résultats. Pour une évaluation rigoureuse de l’efficacité, il est indispensable d’adopter une méthodologie systématique. Par conséquent, les développeurs doivent s’engager à éviter ces erreurs courantes pour améliorer leur compréhension de la complexité algorithmique et la performance des algorithmes.

Conclusion et ressources supplémentaires

La notation Big O représente un outil essentiel dans l’évaluation de la complexité algorithmique, permettant de quantifier et de comparer l’efficacité des algorithmes en termes de performance. En substance, elle fournit une mesure de la manière dont le temps d’exécution ou l’espace mémoire consommé par un algorithme évolue en fonction de la taille de l’entrée. À travers cet article, nous avons approfondi différents aspects de la complexité, notamment les classes temporelles et spatiales, ainsi que des exemples concrets pour illustrer leur application dans la pratique.

Pour enrichir davantage vos connaissances sur la complexité algorithmique et la notation Big O, plusieurs ressources complémentaires sont à votre disposition. Vous pourriez envisager de lire des livres tels que « Introduction to Algorithms » par Thomas H. Cormen, qui propose une exploration détaillée des algorithmes et de leur performance, y compris des analyses de complexité approfondies. De plus, des plateformes d’apprentissage en ligne comme Coursera et edX offrent des cours spécifiques sur l’algorithmique qui traitent de la notation Big O, de son importance, et de son application dans le développement de logiciels.

Enfin, pour ceux qui s’intéressent à des études plus poussées, des articles de recherche récents ainsi que des blogs spécialisés offrent une multitude d’informations, des études de cas et des analyses de performances d’algorithmes modernes. Cela permet non seulement de saisir les fondements théoriques de la complexité, mais aussi d’appréhender ses implications pratiques dans le développement de solutions informatiques optimisées. L’exploration de ces ressources vous aidera à approfondir votre compréhension de la notation Big O et de son rôle fondamental dans le domaine de l’informatique.